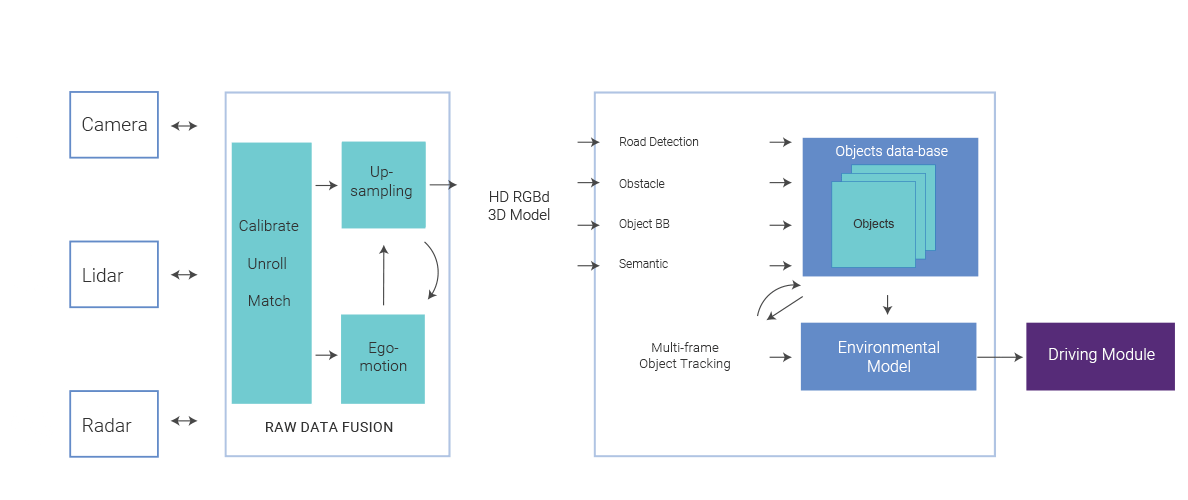

La perception optimisée par la fusion de bas niveau des données

La plateforme logicielle LeddarVision combine l’intelligence artificielle et des technologies de vision numérique ainsi que des réseaux de neurones profonds et l’efficacité computationnelle afin d’optimiser la performance des capteurs et du matériel embarqués essentielle à la planification de la trajectoire dans les véhicules automatisés.

Cette solution d’avant-garde permet la détection des différents objets de la scène, y compris les véhicules, les piétons, les vélos, la voie carrossable, les obstacles, les panneaux, les voies de circulation, les lignes de délimitation des voies et autres. Le système LeddarVision détecte également de très petits obstacles sur la route avec un meilleur taux de détection et moins de fausses alertes que les solutions héritées axées sur la fusion de données « de niveau objet ». Les obstacles non classifiés sont également détectés, ce qui confère un niveau de sécurité additionnel au véhicule.